Immersive eXtended Reality (XR) wird im kommenden Jahrzehnt die innovativsten Entwicklungen im Gesundheitswesen vorantreiben. Die Technologie ermöglicht es, digitale Inhalte so zu erleben, als seien sie Teil der realen Welt. AR-Filter, 360-Grad-Videos und VR-Geräte simulieren interaktive Erlebnisse, die Menschen in ganz neue Welten entführen.

Zwei wichtige Anwendungsbereiche für XR-Technologien sind kostengünstige, klinische und paraklinische Schulungen sowie interaktive, virtuelle Umgebungen für Patient*innen in Therapie und Rehabilitation. Digitale Gesundheitsanwendungen können zudem den Trend zur personalisierten Medizin unterstützen. „Um sich in diese Richtung zu entwickeln, müssen XR-Umgebungen zu intelligenten Systemen werden, die sich an Benutzer:innen anpassen. Ein objektives Feedbacksystem, das auf kognitiv und physiologisch relevanten, digitalen Biomarkern basiert, bietet eine Grundlage für diese Anpassung“, sagt Vanessa Leung, Senior Researcherin am Center for Digital Health and Social Innovation der FH St. Pölten.

Rettungsausbildung und Sturzprävention

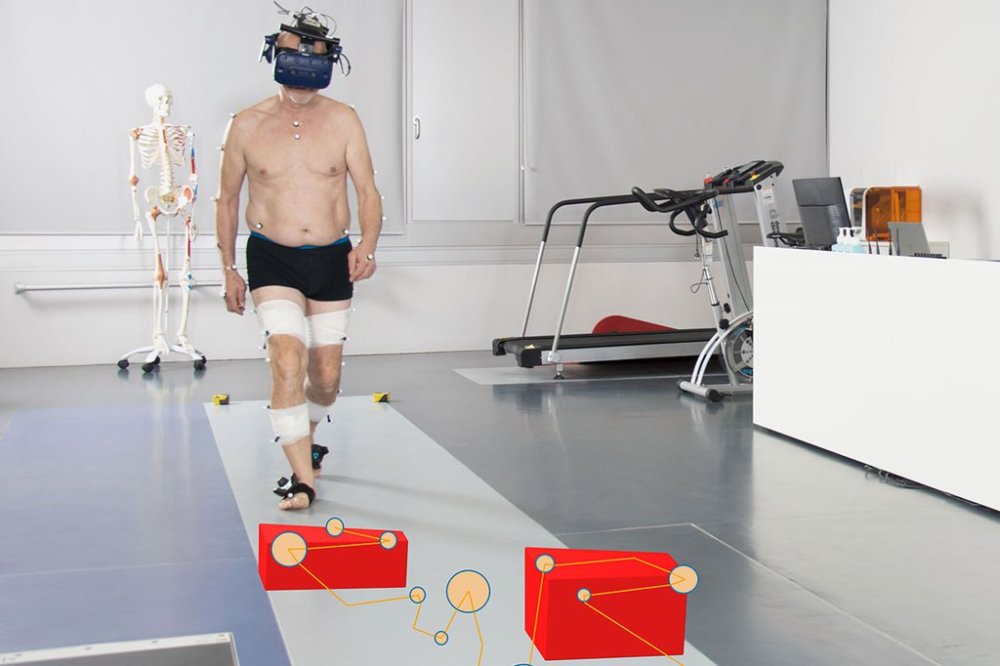

Im Projekt EyeQTrack untersucht Leung XR-Technologien in zwei Anwendungsfällen: der Fehlervermeidung bei der XR-Ausbildung von Rettungsdiensten und der Sturzprävention für Parkinson-Patient*innen in der VR-Motor-Rehabilitation.

„EyeQTrack nutzt moderne Bildverarbeitung, quantitative Analyse und maschinelles Lernen bzw. künstliche Intelligenz, um Information über kognitive und emotionale Reaktionen aus Eye-Tracking-Datenströmen handelsüblicher immersiver XR-Technologien zu gewinnen. Wir schaffen die Wissensbasis für robustes, adaptives XR-Feedback, indem wir Erkenntnisse für Trainings- und Therapieumgebungen aus Augendaten über das Stressniveau, die kognitive Belastung, die Müdigkeit und den Aufmerksamkeitszustand von Nutzer:innen ziehen“, erklärt Leung.

Vertrauenswürdige künstliche Intelligenz für KMUs

Künstliche Intelligenz (KI/AI) basierend auf maschinellem Lernen revolutioniert derzeit praktisch alle Sektoren in Industrie und Wirtschaft. Doch speziell kleine und mittlere Unternehmen (KMUs) stehen vor dem Problem, dass Sie existierende AI-Lösungen nur unzureichend nutzen und so den mit AI generierbaren Mehrwert nicht nutzen können.

„Die Hauptgründe dafür sind hochspezifische Analyseanforderungen von KMUs, für die es keine gebrauchsfertigen KI-Lösungen gibt, mangelnde Adaptionsfähigkeit existierender KI-Services an sich ständig ändernde Anforderungen, intransparente Entscheidungsfindung existierender KI und damit mangelndes Vertrauen vonseiten der Unternehmen sowie unzureichende Mengen an Trainingsdaten für die KI“, sagt Matthias Zeppelzauer, Leiter der Forschungsgruppe Media Computing am Institut für Creative\Media/Technologies der FH St. Pölten und Koordinator des Centers für KI an der FH St. Pölten.

Im Projekt „TrustAI“ entwickelt er interaktiv trainierbare und dynamisch anpassbare KI-Services für die hochspezifischen Anforderungen von KMUs, die durchgängig transparent und daher vertrauenswürdig sind. „Unsere zentrale Innovation ist ein neues interaktives Trainingsparadigma, in dem Mensch und KI in einem wechselseitigen Dialog stehen und durch gegenseitige Erklärungen ein gemeinsames Verständnis von Problemen entwickeln“, erklärt Zeppelzauer. Die im Projekt entwickelten Lösungen sollen KMUs helfen, effizient hochspezifische und gleichzeitig vertrauenswürdige AI-Ansätze zu entwickeln, um ihre Wettbewerbsfähigkeit zu erhöhen.